Tag: hardware

datenträgervernichtung

…durch kaltverformung 😉

ueber die jahre hat sich einiges angesammelt an festplatten. nachdem ich angebote von darauf spezialisierten firmen eingeholt hatte. entschied ich mich dafuer, ca 100 euro fuer die presse zu investieren. klar haette ein grosser vorschlaghammer auch ein aehnliches ergebnis erzielt, aber aufgrund der menge tut die presse halt weniger weh.

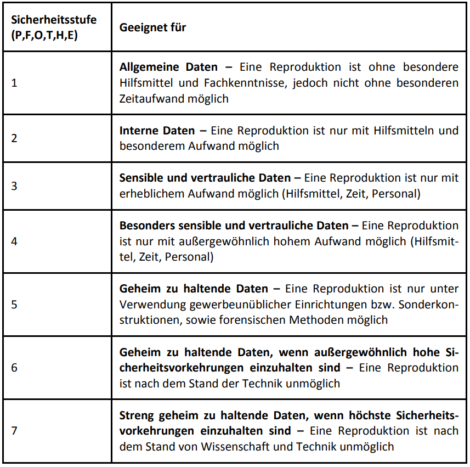

ich bin nur immernoch am raetseln, welcher sicherheitsstufe das nun entspricht. 4 oder 5?

wie gut, dass ich in zukunft nur noch verschluesselte ssds zu entsorgen habe. das gestaltet sich wesentlich einfacher 😉

mal ne runde ssd’s getauscht…

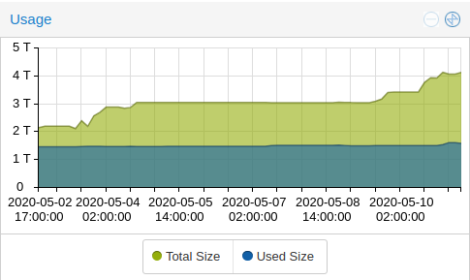

momentan laufen im “home rz” um die 35 VMs.. und der plattenplatz ging langsam zu neige. (ein ceph cluster darf man ja nie voll machen!)

also mal schlappe 15 stueck 1 tb ssds gekauft und die 500 gb dinger im laufenden betrieb eine nach der anderen ausgetauscht.

das reicht mir wieder ne ganze weile 🙂

aktueller ausbaustand “home RZ”

nur kurz die eckdaten:

- Zyxel 48-Port gigabit switch

- Buffalo 12-Port 10g switch

- Fritz!Box Cable 6591

- Fritz!Box DSL 7590

- 2x Alix APU with OPNSense

- 3 x Supermictro X10SDV-4C+-TLN4F,

each node with 128GB RAM, 2x10g, 2x1g, Proxmox, 6x 1TB SSD as Ceph storage - APC 8-Port PDU

… plus ne menge VMs, VLANs, 1400/100 mbit/s brutto internetanbindung, 1A@230V

bei gelegenheit mach ich das auch nochmal schoen 😉

ceph und festplattencontroller

man muss ja selbst seine erfahrungen machen mit ceph & co…. die leute von proxmox schreiben in ihren forumsbeitraegen auch immer, dass man seine hardware vor dem betrieb testen soll.

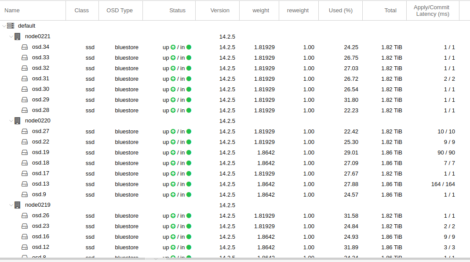

bei einer erweiterung meines ceph storages hab ich gedacht: oh… da ist ein adaptec raid controller drin. mit viel cache und ner backup batterie. und den kann man auch ohne raid betreiben, wenn man den in seinem bios in den HBA mode stellt. gesagt – getan. funktionierte auch erstmal. aber wenn man mal genauer hin schaut, ist die apply/commit latenz bei einigen OSDs um ein vielfaches hoeher, als bei den anderen. hier nur ein beispiel bild, bei dem die werte noch “relativ” niedrig waren. (die node in der mitte des screenshots)

tja – mein gedanke mit “der adaptec controller kanns doch bestimmt besser, als die schnoeden onboard sata dinger” … war dann wohl nix. die ceph doku schreibt “Disk controllers also have a significant impact on write throughput. Carefully, consider your selection of disk controllers to ensure that they do not create a performance bottleneck.”

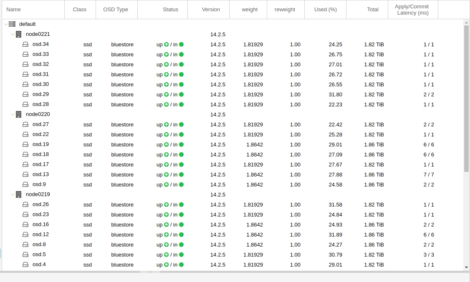

also controller rausgerissen und die ganze sata kabelage ausgetauscht und die onboard intel controller benutzt…. und siehe da.. die latenz ist “normal”:

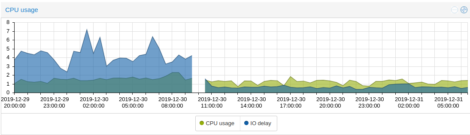

kann man auch wunderschoen beim “IO delay” (in blau) erkennen:

auch die proxmox doku schreibt dazu:

“Avoid RAID

As Ceph handles data object redundancy and multiple parallel writes to disks (OSDs) on its own, using a RAID controller normally doesn’t improve performance or availability. On the contrary, Ceph is designed to handle whole disks on it’s own, without any abstraction in between. RAID controller are not designed for the Ceph use case and may complicate things and sometimes even reduce performance, as their write and caching algorithms may interfere with the ones from Ceph.”

jaja… ist ja gut. wie immer erstmal vorher lesen. aber am besten lernt man natuerlich aus den eigenen fehlern 😉

netgear GS108Ev3 firmware upgrade

fuer den heimgebrauch ist diese serie von netgear ja durchaus OK. selbst wenn man mit VLANs arbeitet, kann man da grundlegende konfigurationen machen und es funktioniert auch meistens. der preis der geraete entschaedigt fuer eventuelle unannehmlichkeiten.

ich wollte mal schauen, ob ich in der config auch einen syslog server eintragen kann… nix gefunden. also mal ein firmware update machen… vielleicht ruesten die sowas ja nach. (das schon vorneweg: nein)

also habe ich das geraet in den firmware-update-modus versetzt und versucht, die neue firmware ueber den browser hochzuladen. das hochladen ging auch… nur dann ist nix mehr passiert. also einmal neu gestartet… und da war das geraet nicht mehr unter der eingestellten ip erreichbar, sondern unter der default ip laut werkseinstellungen (192.168.0.239). firmware update hat trotzdem nicht funktioniert. aber das geraet war nun permanent im update modus.

dann habe ich versucht, tatsaechlich auf werkseinstellungen zurueck zu setzen… keine aenderung. immer noch im update modus.

auf irgendeiner netgear KB seite habe ich dann gelesen, dass es jemand mit allen moeglichen browsern probiert hat, aber nur mit chrome unter windows erfolg hatte. ich hatte auch schon alle moeglichen browser durch… unter anderem auch chromium unter linux. was solls… bevor ich das geraet wegschmeisse, probiere ich es auch mal mit windows und chrome aus…. und siehe da! firmware upgrade hat funktioniert! (anders als das ruecksetzen auf werkseinstelungen – meine einstellungen waren danach noch alle da.)

ich erwarte ja echt nicht viel von einem managebaren switch fuer 35 euro… zumal er ja schon vlans kann. aber man sollte wenigstens mit irgendeinem browser ein firmware update machen koennen und nicht extra dafuer ein windows vorhalten muessen.

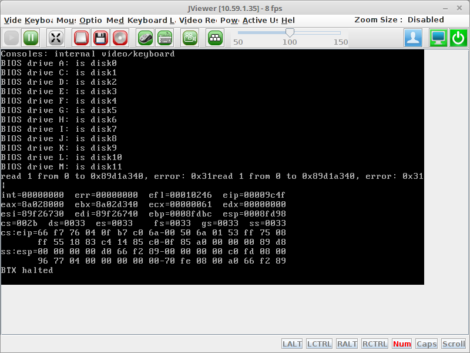

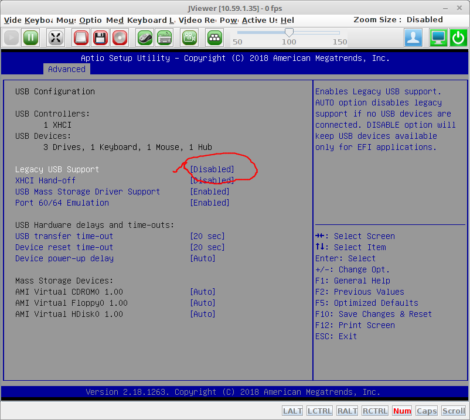

workaround fuer javaws jnpl error “Cannot grant permissions to unsigned jars.”

in mein kleines serverchen habe ich ein “ASMB8-iKVM” rein gesteckt, damit ich nicht immer in den keller rennen muss, wenn ich mal ne vlan config versaut hab und die kiste nicht mehr erreichbar ist 😉

beim starten der java KVM console kam dieser fehler:

Fatal: Application Error: Cannot grant permissions to unsigned jars.

um das zu beheben, muss man in der datei java.security in dieser zeile:

jdk.jar.disabledAlgorithms=MD2, MD5, RSA keySize < 1024

...das "MD5" entfernen. (zeile kopieren, auskommentieren, aendern)

#jdk.jar.disabledAlgorithms=MD2, MD5, RSA keySize < 1024

jdk.jar.disabledAlgorithms=MD2, RSA keySize < 1024

bei meinem linux mint liegt die datei unter: /usr/lib/jvm/java-8-openjdk-amd64/jre/lib/security/java.security

neue “server hardware” fuers home lab

man braucht ja noch projekte… ich baue mir mal ein neues proxmox cluster fuer zuhause. die sache mit den intel nuc’s ist zwar ganz schick, aber die loesung mit externen usb festplatten is doch irgendwie doof. fuer 90% meiner sachen reicht das vollkommen aus, aber manchmal darfs auch ein klein bischen mehr performance sein. da der ganze schrabel noch irgendwie im keller in mein kleines 19 zoll wandrack rein passen soll, ist die auswahl an bauform sehr gering. drei kurze 1he gehaeuse hab ich guenstig in UK erstanden. in den 5 1/4 zoll einbauschacht passt ein 6×2,5 zoll wechselrahmen dings rein, in welches dann ssd’s verbaut werden.

demnach brauche ich auch ein (mini itx) motherboard mit mindestens 6 sata anschluessen. die wahl fiel auf ein asus p10s-i, in welches man alle moeglichen cpu’s mit sockel 1151 stecken kann. angefangen von guenstigen celerons und pentiums bis hin zu guten xeons. zum evaluieren habe ich mir erstmal einen guenstigen pentium 2-core geholt. und prompt bin ich drauf rein gefallen und die cpu war zu neu fuer das board. haette ich vorher mal genauer in die kompatibilitaetsliste geschaut…

auf jeden fall hat das board zwei gigabit nics, welche dann im bond laufen sollen. mal schauen, ob ich spaeter noch eine 10gbe netzwerkkarte da rein bekomme. ein kleines zusatzplatinchen gibts auch, welches dem board zu einem IPMI interface verhilft, fuer welches auch schon ein dedizierter lan port verbaut ist.

RAM gibts fuer den anfang 16 GB an einem stueck. spaeter werden es dann sicherlich 32 GB als “usefull size” werden.

ssds sind ja gerade am billiger werden. anfangen werde ich mit 2x 500gb crucial mx500 als ceph osd’s. vier freie slots lassen noch luft nach oben.

die gehaeuse sind also gesetzt… und wenn dieser erste “prototyp” sich als brauchbar herausstellt, werde ich noch die innereien fuer die beiden anderen gehaeuse bestellen. installiert ist die kiste auf jeden fall schonmal. reingehaengt ins bereits laufende proxmox/ceph cluster ist eine migration ohne downtime und mit anschliessendem rueckbau der “alten” hardware moeglich. einfach nur genial 🙂

ceph blinkenlights

zu dem beitrag mit dem proxmox/ceph cluster gibts noch ein schickes video:

und das im dunkeln anzusehen… hach… das kann jeden nerd dazu bringen, ewigkeiten davor zu stehen und einfach nur stur auf das geblinke zu starren. so wie bei einem lagerfeuer.